Intelligence Artificielle, économies d’échelles, processus de mémorisation, économie du pic.

Comment l’IA peut nous aider à gérer les situations de Pics ?

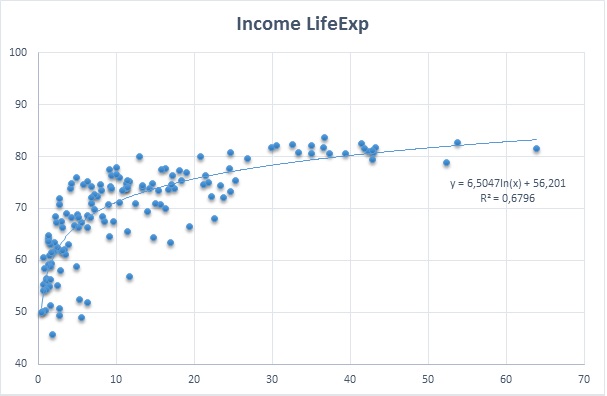

Un pic est une surcharge, une surchauffe, une concentration trop élevée, au même moment et souvent au même endroit. L’IA pourrait produire des recommandations basées sur les observations comportementales au fil de l’eau dans l’objectif de limiter ces situations de pics.

Ce sont les situations de pics qui définissent le dimensionnement des réseaux :

- Pour pouvoir répondre au pic de consommation énergétique quotidien, le réseau doit être capable de délivrer simultanément une énergie X fois plus importante que la moyenne observée sur le reste de la journée. Pour faire face à ces pics en Hiver, le réseau doit s’appuyer sur un certain nombre de centrales d’habitude restées à l’arrêt (Centrales thermiques, à charbon…).

- Les transports en communs et privatifs sont constamment pleins aux mêmes heures et presque inutilisés la majeure partie de la journée.

- L’ensemble des commerces sont ouverts de 9h à 19h en moyenne pour une fréquentation concentrée entre 12h et 14h et à partir de 17h30. Ainsi, la consommation d’énergie observée tout au long de la journée rapportée à la fréquentation pose question.

- La plupart d’entre nous partons en week-end et en vacances sur les mêmes périodes et nous concentrons ainsi sur des routes qui sont beaucoup moins utilisées le reste du temps.

Ainsi, nous sommes continuellement confrontés à des situations de pics : départ en vacances, en week-end, chemin vers le travail, courses alimentaires, shopping.

Si nous prenons uniquement le secteur du shopping, la déperdition énergétique liée à l’ouverture des commerces sur toute la journée pour une fréquentation quasi-nulle sur la majorité des créneaux horaires parait rapidement un non-sens. Au moins 2 autres options sont possibles :

- Permettre un étalement des visites (question générale de société).

- N’ouvrir ces commerces que sur les périodes de temps ou le ratio fréquentation/conso énergétique le justifie.

Aujourd’hui, la centralisation massive des données comportementales ne pourrait-elle pas s’inscrire dans une volonté d’optimisation globale de l’utilisation de nos biens communs (réseaux routiers, réseaux de transports, énergie, services) ?

Ayant en parti pour objectif d’en lisser les usages.

Etablir un roulement ?

Ex lié à la gestion du Pic de pollution.

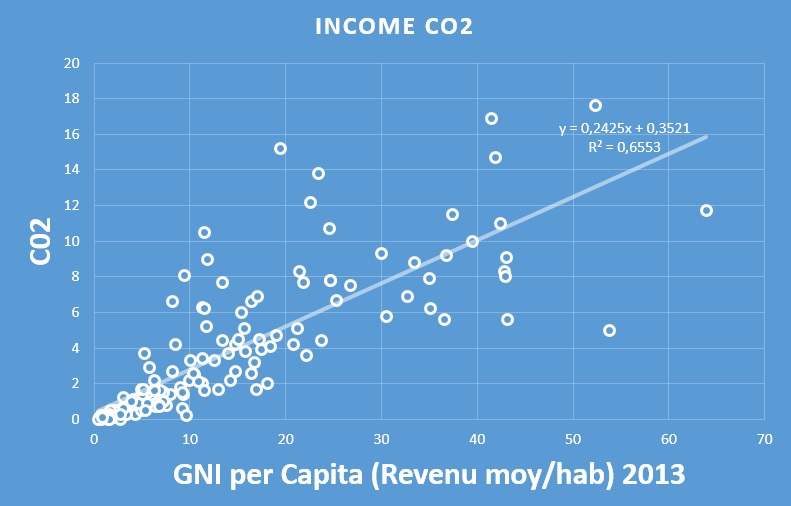

Nous pouvons facilement imaginer que l’IA formule des recommandations liées aux déplacements en véhicules producteurs de CO2, ou plus généralement d’entropie. Connectée en temps réels à l’ensemble des capteurs et ayant connaissance des profils des usagers (types de déplacements, durées, embouteillages anticipé), mais aussi d’appliquer ces recommandations de façon juste, parfois basée sur une randomisation, lorsque aucun critère plus juste ne fait sens et tout cela en prenant en compte des critères d’usages alternatifs (Transports en Commun, télétravail, décalage des trajets dans l’objectif d’éviter la réalisation de pics). Si nous étions prêts à l’utiliser à ces fins, les gains énergétiques, pourraient être considérables.

L’ensemble des éléments, des entités existantes, ont au moins 2 dimensions qui les relient : l’espace et le temps. Ainsi, même dans le cas ou 2 phénomènes sont à-priori complètement disjoints dans l’espace, il est possible qu’ils surviennent au même instant (ex : consommation de ressources dans le cloud), qu’ils s’instancient en même temps, ou tout aussi bien à des moments différents, ce qui n’enlève en rien le fait qu’ils soient reliés par cette dimension temps. Les données sont donc à minima une réalisation sur ces 2 dimensions.

La prise de décision nécessite une instanciation, une situation figée des facteurs, la mesure de cette situation à un instant donné (et donc. Autrement dit, la sensation de continuité est une vue de l’esprit. Elle est en fait une saccade, une succession de micro enchainements neuronaux réalisés à une certaine vitesse, c’est cette vitesse qui nous inscrit dans le monde qui nous entoure. C’est aussi en cela que la machine modifie notre rapport au temps, permettant une succession d’instanciations plus rapide et en ayant connaissance d’un plus grand nombre de facteurs. Elle est donc capable d’élaborer une adaptation à une situation plus rapidement (et omnisciente) que l’ensemble des adaptations relativement disjointes des individus.

Plus d’infos sur le Pic énergétique hivernal : link

L’IA et l’optimisation intra- et inter-entreprises.

Ainsi, à l’échelle d’une entreprise, des questions similaires se posent, comment tirer parti de façon optimale de l’ensemble des espaces partagés : salles de meeting, cantine, cafétaria, télétravail. Comment l’IA peut apporter des réponses en suggérant des adaptations comportementales ? Et ainsi contribuer en retour à une optimisation plus large que celle de l’entreprise en interconnectant (de façon anonymisée) les différentes échelles d’interaction d’entreprises et de privées.

L’IA au service de l’entreprise : link

Pas d’Intelligence sans processus de mémorisation, de rétention :

Notre I est la réalisation d’un choix dans le temps et dans l’espace, l’instanciation d’une décision. Cette décision est prise par rapport à l’affectation de probabilités d’adaptation projetées inconsciemment. Le déroulement de cette décision est quasi-automatique, nous l’avons intégré, ce n’est donc plus un mécanisme complètement conscient. Cette intelligence se résume à une adaptation basée sur un exercice de discrimination entre plusieurs réactions possibles à une situation. Ces « scores » de projection sont intrinsèquement basés sur l’ensemble de nos processus de mémorisation. De chaque situation vécue nait un souvenir, ce souvenir est une nouvelle base pour la formulation d’un choix futur. Aux situations vécues, il convient d’ajouter les situations rêvées, projetées, issues de notre imagination mais dont la réalisation imaginaire permet la conservation d’un souvenir. C’est également le cas pour l’ensemble des « souvenirs » issus de situations non vécues mais visualisées (films, documentaires vidéo), entendues (radio, histoire comptée), imaginées à partir d’un élément transformé (lecture).

L’IA n’échappe pas à l’exercice de mémorisation :

De la même façon qu’un cerveau humain, la concrétisation de l’utilisation d’une IA est rendue possible à partir du moment où elle peut instancier un choix à partir de la mémoire qu’elle possède à un instant donné. Cette mémoire métastable correspond à l’addition de 2 mémoires : celle qui lui a été transmise et celle qu’elle a pu constituer à partir du moment où elle a été mise en fonction. Sachant qu’il existe 2 façons de transmettre une mémoire à l’IA : 1) en utilisant une base d’observations finie ou alimentée au fur et à mesure. 2) un algorithme permettant à la machine de balayer elle-même un certain nombre de « mémoires : fichiers, comportements, tweets… »

Une observation, notion élémentaire du datascientist est la réalisation d’un comportement (ex : « l’entreprise x a envoyé un email à la personne y, la personne y a réagit de telle manière ». Nous voyons ici l’enchainement de plusieurs situations, d’une stimulation d’origine, jusqu’à l’observation de la réaction. Ces observations sont enregistrées et constitueront donc une liste de « stimulations – réactions », à partir de laquelle le programme-machine constituera une historisation, lui permettant de réagir de façon « intelligente », ie, en puisant dans cet ensemble pour adapter ses comportements en fonctions de ces observations (Par exemple : « pour engendrer une réaction attendue de ce type de personne, l’email doit être envoyé à tel moment »). Ainsi, c’est bien l’ensemble de ces historisations qui permettront à la machine de réagir « intelligemment » et toujours en fonction d’un objectif à maximiser (ici : « engendrer la réaction attendue »). Le programme discrimine donc entre l’ensemble de ses comportements possibles dans l’objectif de maximiser tel type de réaction, en fonction de l’ensemble des processus de mémorisation qui lui sont accessibles au moment même où elle doit produire cette instanciation de décision.

Nous concluons ici, que tout comme au niveau de l’I humaine, l’IA évolue à partir de l’observation de ses propres choix et des nouvelles réactions observées (adaptation de l’environnement) dans le temps.

Plus loin sur la rétention : http://arsindustrialis.org/r%C3%A9tention

La vitesse : temps biologique Vs temps électrique.

Nous observons donc une grande similitude entre les 2 Intelligences ci-dessus, les 2 se basent sur l’impression successive (quasi-continue = en rafale) de processus de mémorisations.

Une des différences majeures entre les 2 intelligences citées réside bel et bien dans la vitesse de traitement et d’enregistrement…c’est le caractère métastable de l’Intelligence. Ainsi, même si nos neurones effectuent très rapidement ces exercices de mémorisations et l’instanciation de ces choix, ces derniers s’exercent bel et bien dans un environnement biologique dont la vitesse est relativement lente par rapport à la circulation de l’information à l’intérieur du corps humain. Réaction : j’émet un son, une phrase, je lis ou je regarde un contenu, j’appuie sur un boutton, etc… Le temps d’intégration de cette information dépend directement de la vitesse à laquelle mes organes émetteurs et récepteurs sont capables de transmettre l’information.

Prenons un exemple simple :

Une présentation entre 2 individus (Cas incontournable et souvent 1er dans la construction d’un agent conversationnel) :

« Bonjour, je m’appelle Julien Humain, je suis enchanté de faire votre connaissance », selon le contexte, JH utilisera plutôt :

- le tutoiement Vs le vouvoiement

- l’engagement vers un smalltalk (meteo, « comment c’est passé votre voyage ? »,…)

- selon objectif de la rencontre, engagement de la discussion vers cet objectif (ex : consultant virtuel)

et s’adaptera au contexte (bruit, dérangement, autres facteurs…).

L’interlocuteur répond, généralement en adaptant le style d’approche choisit par JH :

« Bonjour, Carole Humaine, ravie également ».

Les présentations ont pris à minima 60s, à savoir le temps minimal nécessaire pour prononcer ces 2 phrases. Temps incompressible lié à la contrainte biologique de l’organe bouche (prononciation dans l’espace) et de l’organe oreille (perception et transmission au cerveau) …le cerveau quant à lui analyse la phrase interceptée, la compare avec la « base de données » mémoire et transmet beaucoup plus rapidement les différentes réponses possibles à l’organe bouche, etc…

L’ensemble de la scène ci-dessus est enregistrée par les 2 cerveaux présents comme nouvelle observation et vient moduler les scores correspondant. JH et CH ont donc chacun une observation de plus pouvant intervenir dans la future formulation de décisions, particulièrement dans le cas d’une future situation de « présentation » mais dans d’autres cadres également.

Remarquons que c’est également le cas si JH regarde un film et que ce dernier contient une scène de présentation => cette séquence sera enregistrée par JH et elle se sera également déroulée à une vitesse contrainte par le biologique.

Plus d’infos sur le transhumanisme : https://transhumanistes.com/presentation/

Différence 1 entre l’individu et le programme-machine : le volume de données à disposition.

Le PM ne comporte pas la même contrainte biologique que l’être humain : la base de données « présentation » qui peut lui être transmise en 1 seconde comprend déjà beaucoup plus d’observations que celle que JH a pu constituer au cours de sa vie et des situations de présentations vécues. Issues de films, de scènes filmées, de bases de données retranscrites, d’émissions de radios, de livres…En quelques instants, le PM peut mettre à profit une quantité quasi-illimitée de scènes de « présentations » pour formuler une adaptation à une forme de « bonjour ».

Différence 2 entre l’individu et le programme-machine : la vitesse de formulation d’un choix et d’observation d’un résultat.

Dans le cadre de la réalisation d’un jeu soumis à un ensemble de contraintes, le PM peut lui-même générer ses exercices de mémorisations, tout en bénéficiant de son avantage mentionné dans le cadre de la différence 1. C’est le cas du dernier algorithme de google AlphaGoZero : seules les règles du jeu lui sont transmises et en 4 jours il est devient plus performant que son prédécesseur. Comment ? En se dédoublant (création d’un adversaire) et en générant un historique de partie colossal (4 millions de parties)…il a donc mis à profit son principal atout : la vitesse, non contrainte par le domaine biologique. Ainsi, chaque combinaison de parties peut être jouée et rejouée presque à l’infini dans l’objectif d’observer de solides discriminations entre les résultats et finalement d’atteindre les limites de maximisation de la probabilité de gagner.

L’IA, à défaut de couvrir l’ensemble des dimensions de l’Intelligence humaine, en partie inexpliquée, est supérieure à elle à 2 niveaux : le volume et la vitesse. Ainsi, elle s’inscrit dans une autre échelle à 2 niveaux pour prendre ses décisions :

- elle peut considérer un nombre quasi-illimité de paramètres et modéliser leurs interactions à un instant t => effet volume.

- elle peut générer une succession de décision à la vitesse de circulation de l’électricité = s’auto-ajuster en quasi-continu (laps imperceptibles à notre échelle).

Différence 3 entre l’individu et le programme-machine : le PM n’intègre pas de dimension psychologique dans la formulation de ses choix.

Autrement dit, les sentiments n’affectent pas les choix du programme. Chez l’humain, l’affect vient en quelque sorte pondérer les scores qu’il attribue à chacune de ses réactions possibles à une situation. Une telle pondération n’a pas lieu d’être chez le PM. A l’extrême, cela signifie que le PM n’intègre pas par défaut de mécanisme de refoulement, comme on peut parfois le constater chez l’humain. Ce mécanisme protecteur qui permet chez certains humains de se prémunir face à une remise en cause significative de leur fonctionnement propre, n’existe pas chez le PM, en revanche rien n’empêche d’imaginer pouvoir y implémenter à terme un tel processus de protection. Cela reviendrait à intégrer à ce PM un évaluateur de la quantité de remise en question de ses scores et d’empêcher un bouleversement trop radical suite à une nouvelle expérience. Dans les faits, c’est parfois ce que fait le datascientist : en monitorant l’activité d’une IA, il détecte la pertinence des expériences ayant un impact significatif sur sa manière de réagir. Le datascientist peut ainsi choisir de retirer manuellement cette expérience de la mémoire du PM, venant ainsi reproduire une forme de refoulement. « Le datascientist, psychologue de l’IA ? »

L’IA maximise les objectifs que nous lui transmettons :

Le défis est de notre côté. Concrètement, l’IA répond à un système d’équation qui lui a été transmis. Par exemple : répondre de façon adaptée à un interlocuteur, maximiser un profit sous contrainte de disponibilité d’une ressource.

Elle répond donc de façon de plus en plus aiguisée grâce à un nombre de références croissant, en maximisant l’objectif qui lui a été fournis. Quelque-soit le niveau de qualité d’une IA, elle ne sera néfaste pour l’être humain qu’à partir du moment où nous lui transmettons des objectifs eux-mêmes néfastes pour nous-même. L’exemple le plus simple est un cas de science-fiction bien connu, celui de Al, le robot du vaisseau de 2001 qui préfère sauver sa peau plutôt que celle de l’humain qu’elle doit protéger car elle sait qu’il cherche à la détruire…il aurait suffis de lui transmette comme objectif primordial la supériorité de la vie humaine par rapport à la sienne… Retranscris en contexte métier : le monitoring et le suivi par un humain de l’activité d’une IA (ie, un modèle de datascience) et de son évolution sont des taches récurrentes incontournables. Le datascientist sait comment mettre en place les outils de contrôles et d’alertes pour réaliser ces taches de façon efficace. Son rôle étant en partie déterminé par la formulation de plus en plus fine des équations d’objectifs et de contraintes auxquelles les IA devront répondre.

L’IA au service de l’optimisation collective sous contraintes individuelles :

2 français sur 3 ont peur de l’IA, mais au fond, ce n’est pas l’IA en elle-même qui leur fait peur, mais bien les objectifs qui y seront inscrits, les éléments qu’elle cherchera à maximiser (ou minimiser dans le cas de la pollution), c’est-à-dire les contraintes sociales, culturelles. Il devient maintenant urgent de se pencher sur cette question des objectifs et contraintes qui nourriront l’IA de demain et c’est l’occasion incontournable de placer ces décisions dans les mains des futurs bénéficiaires de ces recommandations, c’est-à-dire les peuples eux-mêmes, plus que jamais capables d’interagir avec ces nouveaux outils pour partager leur vécu, leurs contraintes, leurs objectifs personnels qui cumulés, forment les orientations sociétales.

Jonathan Petit

3 startups IA au service de l’Humain : link